【深度】考察了中国人工智能发展,美国无法赢得这场竞赛

讓我們先從一個令人沮喪的事實開始:美國政府花了三年半時間,耗費無數政治資本,精心設計了一套出口管制體系,試圖用芯片短缺來掐死中國的人工智能。然後呢?中國繞過去了。就這樣。

Sebastian Mallaby剛剛在《紐約時報》發表了一篇文章——此君是外交關係委員會的高級研究員,新書寫的是DeepMind和人工智能超級智能,算是圈子裡的體面人物——他跑了一趟北京、上海、深圳、杭州,回來以後說:我考察了中国人工智能发展,美国无法赢得这场竞赛。管制失敗了,而且代價過於高昂。這個結論本身並不新鮮,但他說出這話的時間節點,以及說話的方式,值得我們細細咀嚼。

一、禁令的喜劇性失敗

芯片出口管制的邏輯,乍看之下頗具吸引力:先進人工智能依賴先進芯片,先進芯片體積龐大、難以走私,只要卡住供應鏈,就能卡住中國的算力,進而卡住中國的人工智能野心。這個邏輯在一個封閉的物理世界裡是成立的。問題是,我們生活在一個雲計算的世界。

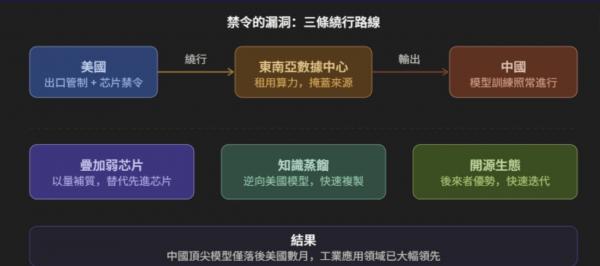

中國的模型開發者需要大量算力?沒問題,去東南亞鄰國的數據中心租幾個月的算力,訓練完模型,打包回國。模型的中國來源?不難掩蓋。這條路徑在禁令頒布之初就已存在,美國的政策制定者或許知道,或許不知道,但無論如何,他們沒能堵住它。

更具諷刺意味的是所謂「知識蒸餾」。每當美國的實驗室——OpenAI、Anthropic、Google——推出一個新的頂尖模型,中國的工程師便以驚人的速度對其進行逆向工程,提煉出能力的精髓,構建出自己的版本。這有一個冠冕堂皇的學術名稱叫做「蒸餾」,本質上就是:你創新,我學習,然後我改進。後來者的優勢,被中國工程師發揮得淋漓盡致。

Mallaby在華為深圳園區坐上了一輛自動駕駛汽車——副駕座上的設備還在為他按摩背部。他補充說,「轉向操作無可挑剔」。這不是科幻小說,這是2026年的現實。

二、「奇點」敘事的修辭功能

大約從2022年開始,矽谷流行一種末日預言式的樂觀主義——我知道這聽起來是個矛盾修辭,但矽谷就是這樣一個能讓矛盾修辭合情合理的地方。這種觀點認為,人工智能將很快進入「智能爆炸」:系統強大到可以自我編寫升級代碼,更好的人工智能創造更好的人工智能,以此遞推,直到某個「奇點」在人類反應過來之前已然發生。而在這場競賽中,哪怕只領先幾個月,也意味著勝者通吃。

這個敘事的政治功能,比其技術內容更值得研究。它的邏輯推論是:既然每一天的領先都無比珍貴,那麼任何能夠減緩對手進步的手段——哪怕只是稍微減緩——都是值得的。芯片管制的支持者至今仍在用這套邏輯辯護:即便管制沒能阻止中國,但它讓中國慢了一點,而那一點點延遲是有價值的。

問題在於:Mallaby的實地調研動搖了「奇點決定論」的另一半假設。他指出,真正重要的不是頂尖模型的原始算力,而是人工智能的實際落地。在工廠、高鐵、礦山、醫療系統裡的部署,才是決定誰贏得這場競賽的關鍵。而在這個維度上,受到美國制裁的華為和海康威視,正在推出一個又一個具體的應用系統。制裁,顯然沒能阻止它們。

三、核不擴散條約的隱喻:一個遲來的良知

Mallaby文章最有趣的部分,也是最具政策想象力的部分,是他提出的替代方案:一項類似1968年《核不擴散條約》的人工智能國際協議。

這個類比相當大膽。《核不擴散條約》誕生於古巴導弹危機後的六年,是美蘇在核戰邊緣的共同恐懼推動下達成的。兩個超級大國彼此都清楚地看到了對方臉上的汗珠,於是決定共同設立一道防護欄。Mallaby的意思是:現在的中美人工智能競賽,是否已到了需要類似機制的時刻?

他在北京、上海、深圳與十多位人工智能領袖交談後得出結論:中國精英確實關心人工智能安全問題。他拜訪的某家科技公司——一家開源大模型廠商——其CEO坦言:隨著人工智能越來越強大,繼續保持開源將是「瘋狂」之舉。那位CEO的比喻尤為生動:你不會把核武器開源。

這個比喻說明什麼?說明中國的技術精英,在某種程度上,是用與美國安全研究者相同的語言在思考同樣的問題。這是對話的基礎,還是各說各話的表面共識?我傾向於保持審慎樂觀。

四、OpenClaw事件:恐懼是真實的

Mallaby在文中提到了一個細節,我認為比他的整體論證更有分量。他訪華期間,一個名叫OpenClaw的先進智能體在中國引發了巨大爭議。大量普通用戶下載了這個強大的助手,熱情程度令人咋舌。但研究人員和行業領袖對此感到震驚——一位商學院教授警告說,這個智能體會讓你的電腦「裸奔」。隨後,中國領導層迅速出手,明確反對在政府系統中使用OpenClaw,並向公眾發出數據安全警告。

這個細節的重要性在於:它說明了中國官方對人工智能失控風險的真實焦慮,並不僅僅是說說而已的外交辭令。當一個強大的外國智能體在本國民間廣泛擴散,北京的第一反應是管控,是安全警告,而不是照單全收。這與美國安全研究者的邏輯,在某個深層次上是吻合的。

五、石書重的裁決

我必須承認,Mallaby的論證打動了我的一部分理智——雖然我的直覺仍然保持懷疑。他的核心主張是對的:芯片管制失敗了,繼續執行的代價超過了收益,因為它關閉了合作的可能性,而那些合作的可能性,在應對人工智能這個真正共同挑戰時,可能比任何技術領先都更有價值。

但他低估了幾件事。

第一,中美之間的政治信任赤字,已經遠遠超過了1962年到1968年美蘇之間的水平。古巴導彈危機給雙方都留下了生死攸關的震撼,那種震撼的物理性是毋庸置疑的——核彈頭真實存在,射程計算清晰可查。人工智能的風險,目前在很大程度上仍然是假設性的,或者至少在感知上缺乏同等的緊迫性。

第二,「技術精英支持合作」並不等於「政府會採納合作」。在任何大國,尤其是在中美兩個體制差異巨大的大國,決策路徑從來不是線性的。一位科技公司CEO對Mallaby說的話,和北京中南海裡最終拍板的考量,可能相距甚遠。

第三,也是最根本的一點:即便達成了一個類似NPT的人工智能協議,誰來核查?核武器的核查機制建立在可測量的物理現實之上——鈾濃縮、導彈射程、核試驗的地震波。人工智能的能力邊界在哪裡?一個「合規」的模型和一個「危險」的模型之間的差距,是否可以通過某種技術手段加以驗證?這些問題,沒有現成的答案。

所以,我們站在一個很奇特的位置上:管制失敗了,合作又障礙重重,競爭仍在加速,而誰都無法確定終點在哪裡。

矽谷有一句老話:「Move fast and break things.」快速行動,打破一切。人工智能的時代,兩個超級大國都在按這個邏輯行事。區別只在於,被打破的,可能不只是舊的商業模式。

圍棋的最終結局,從來不由一步棋決定。但每一步,都在改變棋盤上的氣數。